8月11日,智谱ai推出全球100b级效果最佳的开源视觉推理模型 glm-4.5v(总参数 106b,激活参数 12b),并同步在魔搭社区与hugging face开源。此外,api调用价格低至输入2元/m tokens,输出6元/m tokens。

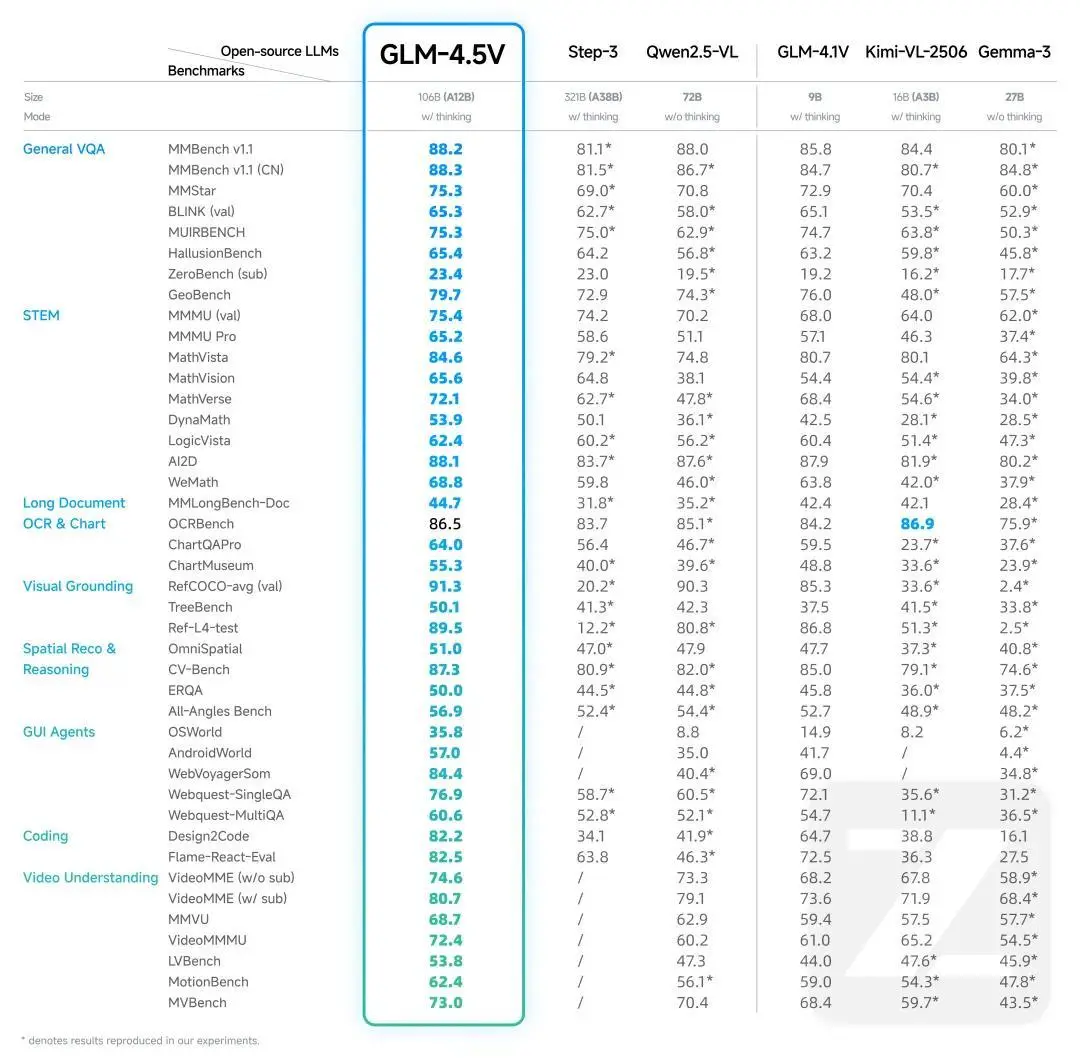

glm-4.5v基于智谱新一代旗舰文本基座模型glm-4.5-air,延续glm-4.1v-thinking 技术路线,在41个公开视觉多模态榜单中综合效果达到同级别开源模型sota性能,涵盖图像、视频、文档理解以及gui agent等常见任务。比如,glm-4.5v能够根据用户提问,精准识别、分析、定位目标物体并输出其坐标框。

据介绍,多模态推理被视为通向通用人工智能(agi)的关键能力之一,让ai能够像人类一样综合感知、理解与决策。其中,视觉-语言模型(vision-language model, vlm)是实现多模态推理的核心基础。